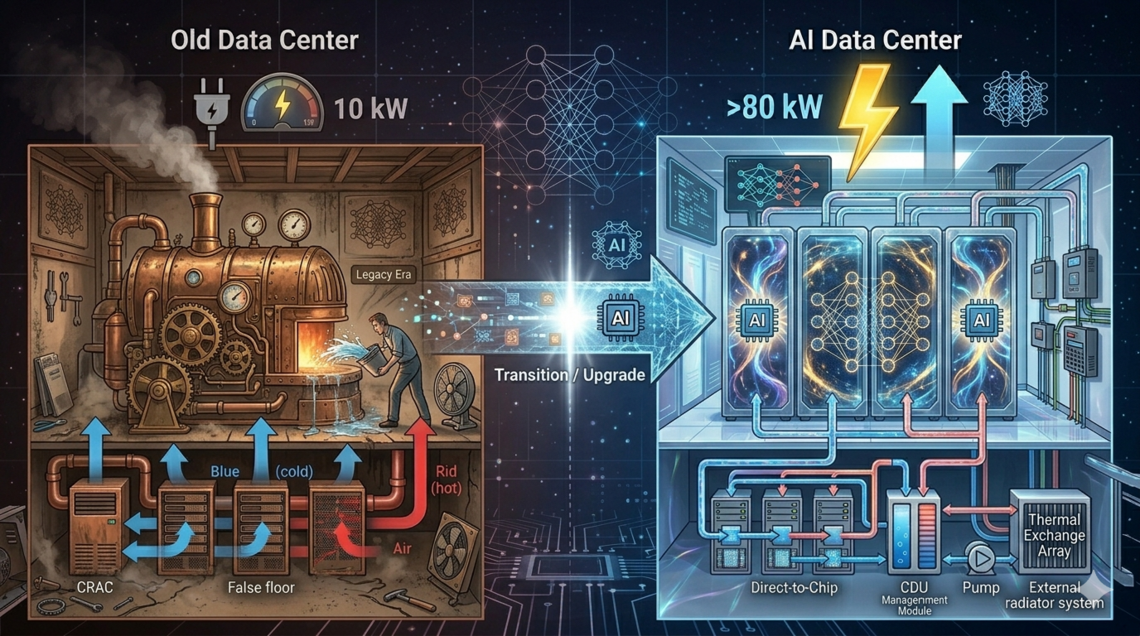

ПЕРЕХОД С 10 кВт НА 80 кВт

СМЕНА ПАРАДИГМЫ

В последние два года руководство технологических департаментов регулярно сталкивается с одним и тем же запросом: как разместить ИИ-нагрузку в действующем дата-центре. Инициатива выглядит логичной на бумаге. Существующее здание, проверенные системы мониторинга, знакомый персонал. Достаточно заказать серверы с высокой плотностью вычислений, подключить их к розеткам и обновить коммутаторы. Однако реальность инфраструктуры диктует иные правила. Большинство действующих объектов строились с расчётной мощностью 7–15 кВт на стойку. Искусственный интеллект требует более 80 кВт на квадратный метр. Это не линейный рост. Это смена физических констант.

Проблема: иллюзия линейной модернизации

Многие руководители ИТ-департаментов совершают системную ошибку. Они полагают, что переход на высокие мощности — это вопрос выбора более производительной позиции в каталоге поставщика. Логика кажется простой: заменить устаревшие процессоры на графические ускорители, увеличить лимиты в системе учета и запустить обучение моделей. Но причинно-следственная цепочка инфраструктуры не терпит упрощений. Увеличение потребляемой мощности в 8 раз запускает каскад ограничений, которые невозможно обойти программными патчами или точечными закупками.

Разница между 10 кВт и 60–80 кВт — это не эволюция. Это тотальный разрыв. Попытка втиснуть ИИ-кластер в классическую серверную аналогична попытке поставить реактивный двигатель в паровой вагон. Система не адаптируется. Она разрушается. Специалист по инфраструктуре высокопроизводительных вычислений

Первый удар приходится на энергосистему. Традиционные щитовые и кабели рассчитаны на стабильный, предсказуемый ток. ИИ-нагрузка создает импульсные пиковые потребления, которые перегружают автоматы и вызывают просадки напряжения. Следствием становится необходимость пересмотра всей цепочки: от точки ввода высокого напряжения до распределительных шкафов в зале. Инвестиции в новые подстанции и линии электропередач иного сечения исчисляются сотнями миллионов рублей. Эти затраты должны были быть заложены на этапе фундамента, а не вноситься как поправочный бюджет.

Второй удар принимает система охлаждения. Мы наблюдаем конец эпохи классических прецизионных кондиционеров. При мощности 80 кВт на стойку воздушный поток физически не способен отвести тепловую нагрузку без создания аэродинамических условий, сопоставимых с реактивной струей. Возникает термодинамический тупик: либо серверы троттлят и снижают производительность, либо перегреваются и выходят из строя. Единственный рабочий путь — переход на жидкостное охлаждение. Это требует прокладки трубопроводов, установки насосных станций, внедрения систем аварийного слива и полной переработки противопожарных регламентов. Гидравлика заменяет вентиляцию.

Третий фактор — структурная нагрузка. Стойки с графическими процессорами весят тонны. Традиционные фальшполы, рассчитанные на 500–750 кг на квадратный метр, деформируются под экстремальным весом. Современные ИИ-объекты требуют перехода к монолитным плитам с несущей способностью до 3 000 кг на квадратный метр. Это вопрос сопромата, а не ремонта. Усиление перекрытий в действующем здании равносильно реконструкции.

Четвертый разрыв — сетевой. ИИ-алгоритмы требуют беспрецедентной связности. Для синхронизации работы тысяч графических ускорителей необходимо в 10 раз больше оптоволокна, чем в классических решениях. East-West трафик заменяет привычную клиент-серверную модель. Кабельные каналы переполняются. Требуется построение сложных фабрик на базе InfiniBand или RoCE, что меняет топологию соединений на фундаментальном уровне.

Пути решения

Признание невозможности простой модернизации открывает три стратегических вектора. Каждый из них требует четкого понимания экономики и сроков.

Полный редизайн с нуля

Проектирование нового объекта с расчётной мощностью 80+ кВт на стойку. Энергоснабжение, жидкостное охлаждение, монолитные полы и оптоволоконные магистрали закладываются на этапе архитектурного проекта. Инвестиции в объект мощностью 50 МВт начинаются от 2,5 миллиарда рублей. Срок реализации составляет 24–36 месяцев. Это единственный путь, гарантирующий отсутствие скрытых ограничений.

Гибридная архитектура

Сохранение действующего дата-центра для традиционных рабочих нагрузок и строительство изолированного модуля для ИИ-кластеров. Подход позволяет диверсифицировать риски и не списывать унаследованные активы. Стоимость специализированного модуля варьируется от 900 миллионов до 1,8 миллиарда рублей в зависимости от плотности размещения и класса надежности.

Колокация и облачная аренда

Использование уже построенных ИИ-дата-центров сторонних операторов. Это самый быстрый путь к запуску рабочих нагрузок. Однако совокупная стоимость владения за пятилетний горизонт может превысить 3,2 миллиарда рублей при нагрузке в 10 МВт. Модель подходит для тестирования гипотез, но экономически нецелесообразна для долгосрочных производственных контуров.

Выгоды стратегического подхода

Компании, которые отказываются от иллюзии модернизации и выбирают редизайн, получают измеримые преимущества.

Первое — предсказуемая экономика. Новый ИИ-объект имеет совокупную стоимость владения на 35–40% ниже, чем модернизированный старый зал. Экономия достигается за счёт отсутствия затрат на адаптацию несовместимых систем и устранения простоев из-за перегрева или отключений питания.

Второе — масштабируемость. Инфраструктура, спроектированная с запасом по мощности и гидравлике, позволяет наращивать вычислительные ресурсы без остановки бизнеса.

Третье — кадровая адаптация. Технологическая сложность порождает потребность в экспертах принципиально иного уровня. Классический системный администратор, привыкший к виртуальным машинам, бессилен перед спецификой GPU-кластеров. На рынке формируется новая элита:

- Infrastructure Engineers — архитекторы, понимающие стык между вычислительным оборудованием и энергетикой

- MLOps-инженеры — специалисты по жизненному циклу моделей и пайплайнам обучения

- HPC SysAdmin — администраторы высокопроизводительных систем с навыками работы в среде Linux-кластеров

- GPU Reliability Engineers — эксперты по отказам HBM-памяти и топологиям NVLink

- AI Platform Engineers и Deep Learning Systems Engineers — создатели платформ для оркестрации вычислительных ресурсов

Выводы

Переход от дата-центра с мощностью 10 кВт на стойку к ИИ-инфраструктуре с мощностью более 80 кВт — это не вопрос бюджета. Это вопрос признания того, что мы имеем дело с принципиально иной технологической парадигмой. Пять фундаментальных разрывов — энергетический, термодинамический, структурный, сетевой и кадровый — доказывают, что попытка модернизировать старый объект обречена на создание инфраструктурного долга. Этот долг растет экспоненциально и требует постоянных аварийных вливаний.

Правильный путь — признать невозможность точечного апгрейда и выбрать стратегию полного редизайна, гибридного строительства или стратегической колокации. Каждая из них требует капитала, но только проектирование с нуля гарантирует, что инфраструктура выдержит вызовы следующего десятилетия. Вопрос не в том, сколько рублей нужно вложить. Вопрос в том, готовы ли руководители признать, что старый дата-центр — это не платформа для будущего, а музей прошлого.

Это не улучшение. Это полный редизайн.

Оставайтесь на связи

Подпишитесь на новостную рассылку и будьте в курсе всех интересных событий и предложений!

Никакого спама гарантированно!