РАСПРЕДЕЛЁННАЯ АРХИТЕКТУРА

ОТ ЕДИНОЙ ТОЧКИ К РАСПРЕДЕЛЕННОЙ СЕТИ

Партнерство NVIDIA и SPAN показывает, что следующий фронт AI-инфраструктуры может определяться не размером Дата центра, а тем, насколько быстро компания способна превратить уже существующую электрическую емкость в полезные вычисления.

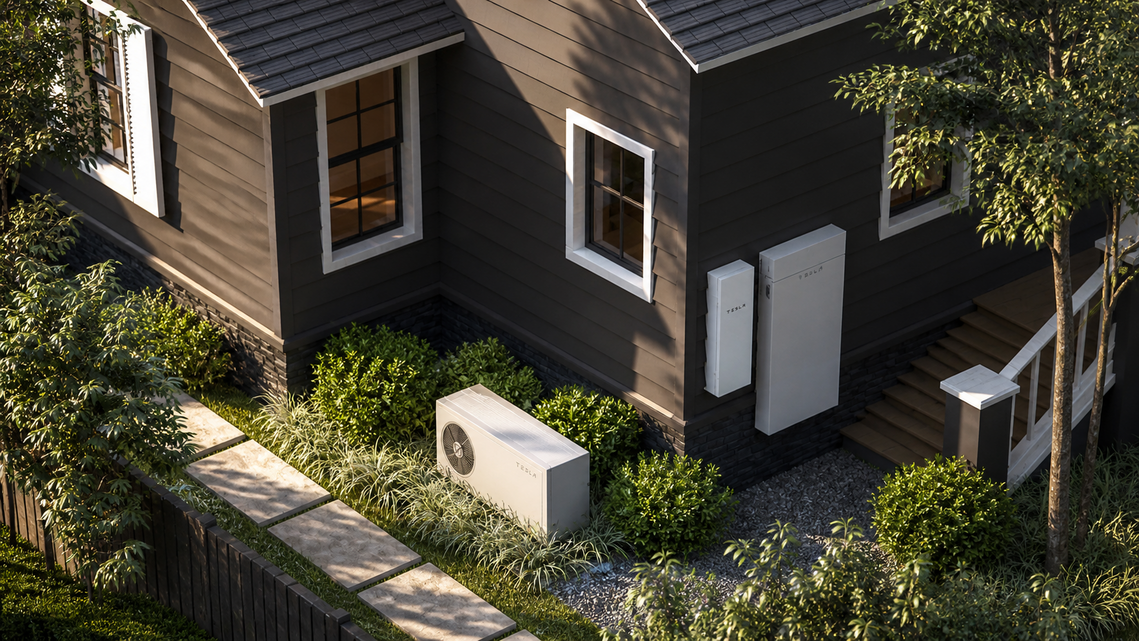

Большие дата-центры строились под одну логику: собрать мощность в одном месте, обеспечить ее охлаждением, подключением к сети и управлением, а затем масштабировать объект годами. Но именно эта логика сегодня становится узким местом. SPAN в апреле объявила XFRA — распределенную систему вычислительных узлов, размещаемых в жилых и малых коммерческих пространствах, а NVIDIA названа в релизе initial launch partner. Компания также заявила, что запуск будет опираться на жидкостно охлаждаемые NVIDIA RTX PRO 6000 Blackwell Server Edition GPU.

Причина сдвига

Причина проста: спрос на AI-инференс растет быстрее, чем допускает традиционный цикл строительства. В релизе SPAN прямо говорится о дефиците мощности и о том, что существующая сетевая инфраструктура может быть использована лучше. NVIDIA в своем публичном позиционировании уже говорит о AI Grid, то есть о масштабировании AI через связанную распределенную инфраструктуру, а не только через монолитные площадки. Это не маркетинговая формула. Это признание физического ограничения: энергия, земля, согласования и межсетевые подключения больше не сходятся по времени с ростом спроса.

Как устроена ставка

XFRA, по описанию SPAN, использует интеллектуальные электрические панели компании как механизм извлечения дополнительной электрической емкости из уже существующей инфраструктуры. Иначе говоря, компания пытается монетизировать не новый участок земли под строительство Дата центра, а недоиспользованную емкость в зданиях, где уже есть подключение к сети. В этом и состоит ключевой разворот: вычислительный узел перестает быть отдельным индустриальным объектом и становится частью городской ткани.

Это попытка закрыть разрыв между потребностью и ожиданием, которое обычно измеряется не кварталами, а годами.

Экономика против инерции

У централизованной модели есть внутренняя жесткость. Чем крупнее объект, тем дороже ошибка в проектировании, тем тяжелее подключение, тем выше стоимость задержки. SPAN утверждает, что ее схема позволяет использовать существующую сетевую емкость и масштабировать compute быстрее, чем при новом строительстве. PulteGroup, по словам своей стороны, видит в XFRA способ снизить стоимость строительства и использовать недоиспользованную электрическую инфраструктуру дома на пользу сети. Это важная деталь: когда девелопер начинает считать вычисления как часть инженерной экономики здания, AI-инфраструктура перестает быть внешней надстройкой. Она встраивается в объект недвижимости.

Латентность как коммерческий аргумент

У распределенной схемы есть еще одно преимущество, которое обычно недооценивают до момента, пока не упираются в производительность: география распределения. NVIDIA в релизе прямо говорит о необходимости low-latency решений, близких к конечному пользователю. Для inference это не второстепенная характеристика, а часть продукта. Чем ближе вычисление к источнику запроса, тем меньше транзитная задержка и тем устойчивее сервис на высокой нагрузке. В этом смысле edge не просто модное слово. Это способ сократить задержку между запросом и ответом.

Но у децентрализации есть цена

Распределенная архитектура не отменяет базовые ограничения, она лишь перераспределяет их. Сотни или тысячи мелких узлов требуют другого уровня оркестрации, сервисной дисциплины и киберзащиты. Управлять одной большой машиной сложно. Управлять сетью малых машин, встроенных в чужую среду, сложнее в разы. Дополнительный риск создает зависимость от стандартизации размещения, обслуживания, телеметрии и договорной модели с владельцем объекта. Если эти параметры не замкнуты, экономика дезинтегрируется раньше, чем начнет масштабироваться. Это уже не вопрос идеи. Это вопрос операционной реализуемости.

Что это означает

История XFRA важна не как единичный продуктовый анонс, а как симптом. Индустрия ищет способы обойти дефицит мощности, задержки подключения и стоимость гигантской централизации. В этой логике традиционный дата-центр не исчезает. Он просто теряет монополию на роль единственного места, где рождаются вычисления. Будущее, вероятнее всего, будет гибридным: крупные кампусы для плотных нагрузок, распределенные узлы для latency-sensitive сценариев и инфраструктура здания как новый слой вычислительной экономики.

Основано на публичном релизе SPAN от 13 апреля 2026 года, материалах SPAN о XFRA и публичных страницах NVIDIA по AI Grid и distributed AI infrastructure.

Оставайтесь на связи

Подпишитесь на новостную рассылку и будьте в курсе всех интересных событий и предложений!

Никакого спама гарантированно!